Si hay un archivo a la que pocos usuarios le hacen caso dentro de una página web, es al archivo robots.txt. Pero realmente pocos saben realmente para qué sirve y realmente qué hace.

Si eres de los que se toma el SEO en serio, es probable que hayas oído hablar de este archivo. Realmente su función es mucho más importante de lo que parece, es como una especie de portero de discoteca que decide quién entra en tu web y quién no, o dónde se puede entrar o dónde no.

Para empezar, si no sabes cómo crear un archivo robots.txt no te preocupes porque muchos gestores de contenido, como WordPress, lo crean por defecto. Tampoco es necesario subirlo a Google Search Console o Bing Webmasters Tools. Los buscadores lo encuentran por sí solos para recibir instrucciones sobre cómo van a rastrear e indexar tu sitio web. Es como una especie de mapa para los bots de los buscadores.

Si utilizas plugins de WordPress como Yoast SEO o Rank Math también generan el archivo de forma automático. Si quieres editar el archivo robots.txt con estos plugins también puedes hacerlo (recuerda que a veces algunos sistemas de seguridad no permiten editar archivos, por lo que tendrás primero que desactivar esa opción).

Otra cosa es que quieras comprobar que tu archivo robots.txt está bien generado y no tiene ningún error. Entonces puedes acceder a esta página, y desde ahí acceder a la propiedad de tu sitio web para validar el archivo robots.txt y quedarte tranquilo que no contiene ningún error.

En realidad, es un archivo de texto supersencillo. Podrás crear un archivo robots.txt con el bloc de notas. Una forma de no arrastrar contenido ilegible y que puede que no veamos.

Para crealo veamos un ejemplo de archivo robots.txt que puedes aplicar a tu sitio web. Este ejemplo es el que un WordPress crea por defecto:

Una forma muy útil de sacarle partido es ver cómo lo tiene configurado tu competencia. Pero cómo ver el archivo robots.txt. Muy sencillo. Todas las páginas web la deben tener en lar ruta nombredelsitioweb.com/robots.txt.

User-agent: *

Disallow: /wp-admin/

No Index: /secreta/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://coodek.com/sitemap_index.xmlPero vamos a explicar lo que significa cada instrucción para que podamos entenderlo y luego aplicarlo a cualquier sitio web:

- ⏩ User-agent: Este es el nombre del bot al que te diriges. Un asterisco (

*) significa “todos los bots”. Así que cualquier robot (sin importar su nombre) va a leer las instrucciones. - ⏩ Disallow: Si tienes áreas privadas en tu sitio que no quieres que Google (o cualquier otro bot) vea, las bloqueas aquí.

- ⏩ No Index: Estamos diciéndole a los buscadores que no indexen ese contenido.

- ⏩ Allow: A veces, podrías bloquear una carpeta completa, pero permitir que una página específica dentro de esa carpeta sea rastreada. Es como permitirle a ese amigo raro que entre solo a la cocina (pero no a la sala).

- ⏩ Sitemap: Más que una instrucción es recordarle a Google dónde está nuestro Sitemap. Se recomienda que esté presente en el archivo robots.

Este sería un archivo muy básico. Pero podemos añadirle más instrucciones

Una forma muy útil de sacarle partido es ver cómo lo tiene configurado tu competencia. Pero cómo ver el archivo robots.txt. Muy sencillo. Todas las páginas web la deben tener en lar ruta nombredelsitioweb.com/robots.txt. No tienes por qué hacerlo de la misma forma, pero te pueden dar pistas, sobre todo si tu competencia tiene más visibilidad que tú en Google o cualquier buscador.

A continuación veamos los diferentes usos que tiene un archivo robots.txt y cómo le podemos sacar partido. Una vez veas para qué sirve podrás aplicar tus propias reglas en el archivo robots y exprimir al máximo tu sitio web.

Para qué sirve el archivo robots.txt

A continuación veamos los diferentes usos que tiene un archivo robots.txt y cómo le podemos sacar partido. Una vez veas para qué sirve podrás aplicar tus propias reglas en el archivo robots y exprimir al máximo tu sitio web.

1. Mantener a los bots fuera de zonas privadas y de gestión

Como mencioné antes, hay páginas y áreas que no deberían ser indexadas, como es el área de administración o páginas de prueba. No necesitas que Google indexe la página “Gracias por tu compra”, ¿verdad? Pues bloquea esas páginas con el archivo robots.txt y evita que los bots hagan un desastre.

2. Evitar el rastreo de contenido duplicado

Hablar de contenido duplicado en una página web son palabras mayores. Es uno de los grandes problemas con los que deben lidiar muchas webs y muchas tiendas online. De hecho, me atrevería a decir que es una de las principales razones por las que muchos sitios web fracasan.

Google odia el contenido duplicado. Si tienes versiones duplicadas de tus páginas por alguna razón (filtros de productos, por ejemplo), es mejor que les pongas un “No pasar” a los bots para evitar que Google te castigue por ello. Así que, adiós a esas páginas de contenido inútil y que el archivo robots.txt te puede ayudar a gestionar.

3. Optimizar el presupuesto de rastreo

Si tienes un sitio web enorme con un millón de páginas, los bots no pueden rastrear todo al mismo tiempo. Usar robots.txt sabiamente puede asegurarte de que los motores de búsqueda gasten sus recursos en las páginas más importantes de tu sitio, como esas aterradoras páginas de productos o esas publicaciones de blog que realmente importan. Deja las páginas menos relevantes para después, o mejor aún, ni las dejes entrar.

Está claro que existen muchas formas de optimizar el presupuesto de rastreo, y el archivo robots.txt te puede echar una mano.

4. Instrucciones a medida para diferentes bots

Normalmente, cuando hablamos de bots pensamos solo en los bots de los buscadores, cuando en realidad hay muchos más. Y algunos nada benignos. Más que nada porque si hay muchos bots rastreando tu sitio web que pueden mermar el rendimiento de tu sitio. Es como si tuvieras una casa abierta a todo el mundo y gente o personas que no te interesan que estén ahí.

¿Tienes un bot que no te gusta mucho? Pues impídele que rastree tu web. Un sitio web que siempre me ha llamado la atención por la cantidad de bots que bloquea es el diario El Mundo. Mira su archivo robots.txt y podrás ver la cantidad de bots que bloquea: https://www.elmundo.es/robots.txt (al menos en el momento de escribir este artículo).

También existen bots para rastrearte, como algunas herramientas de SEO que quieren espiarte. En estos casos suele ser la competencia. Pues si quieres impedirles que te espíen, puedes restringirles el acceso. Bien es cierto que existen herramientas que se disfrazan del bot de Google para espiarte. Pero a veces, se trata de ponerles trabas a los espías.

5. Ayudar a los buscadores a localizar el sitemap

No todo el mundo realiza esta acción. Pero siempre es recomendable añadir el sitemap al archivo robots.txt. Nunca está de más, ayudar a los buscadores a localizar nuestros archivos más importantes. Normalmente se añade al final del archivo robots.txt : Sitemap: https://coodek.com/sitemap_index.xml

6. A veces, Google no te hace caso

A veces Google es desesperante. Aunque los archivos robots tienen mucha autoridad en cuanto a lo que los bots pueden y no pueden rastrear, tiene sus limitaciones. A veces le damos la instrucción de que no indexe una página, y Google hace caso omiso a esa instrucción y la indexa. Nosotros le damos la instrucción, luego Google hace lo que quiere.

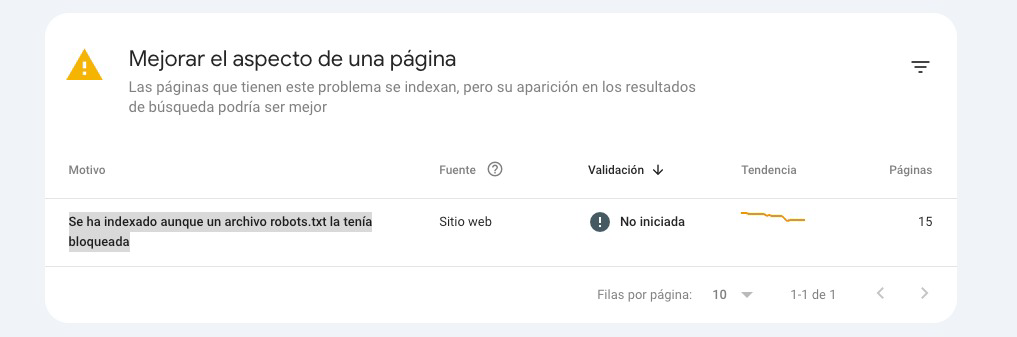

Tengo que reconocer que a veces que te aparezca el mensaje “Se ha indexado aunque un archivo robots.txt la tenía bloqueada” es un pequeño desafío. Tú le dices a Google que no indexe ese contenido y el buscador pasa de tu instrucción.

¿Y qué podemos hacer en este caso? Pues no resulta fácil la solución. Pero veamos algunas posibles soluciones:

- 🛠️ Eliminar enlaces hacia ese contenido: En principio, Google puede que haya indexado ese contenido porque recibe enlaces desde algún sitio web. Puede que sea un enlace interno, por lo que deberías eliminar cualquier enlace interno a ese contenido.

- 🛠️ Eliminar la URL del buscador. Puedes decirle a Google que retire ese contenido a través de la opción Retirada de URL.

- 🛠️ Código 410. A lo bruto, elimina ese contenido y dile a Google que ese contenido no existe a través de establecer un código 410 a esa página.

Conclusión: ¡No subestimes el poder del archivo robots.txt!

En resumen, el archivo robots.txt un héroe anónimo en el mundo del SEO. Con él, puedes mejorar el rastreo, evitar el contenido duplicado y proteger las zonas privadas de tu sitio. Eso sí, debes conocer bien las reglas y ser consciente de qué áreas son importantes y cuáles no lo son.

¡Pero cuidado! Un archivo mal configurado puede ser un desastre para tu SEO, así que asegúrate de que tu archivo robots esté correctamente configurado y no estés bloqueando accidentalmente páginas clave. No sería la primera vez que nos encontramos con un cliente que sin saberlo le estaba diciendo a Google que no le indexe.

Al final, el archivo robots.txt es tu herramienta para asegurarte de que la fiesta digital de tu sitio web se desarrolle sin problemas y sin intrusos. ¡Así que ponlo a trabajar y mantén a los bots en su lugar!